Halcinina-Gen

Spot dove il tuo LLM potrebbe commettere errori sui documenti

In Evidenza

10 Voti

Tendenza

128 Visualizzazioni

Descrizione

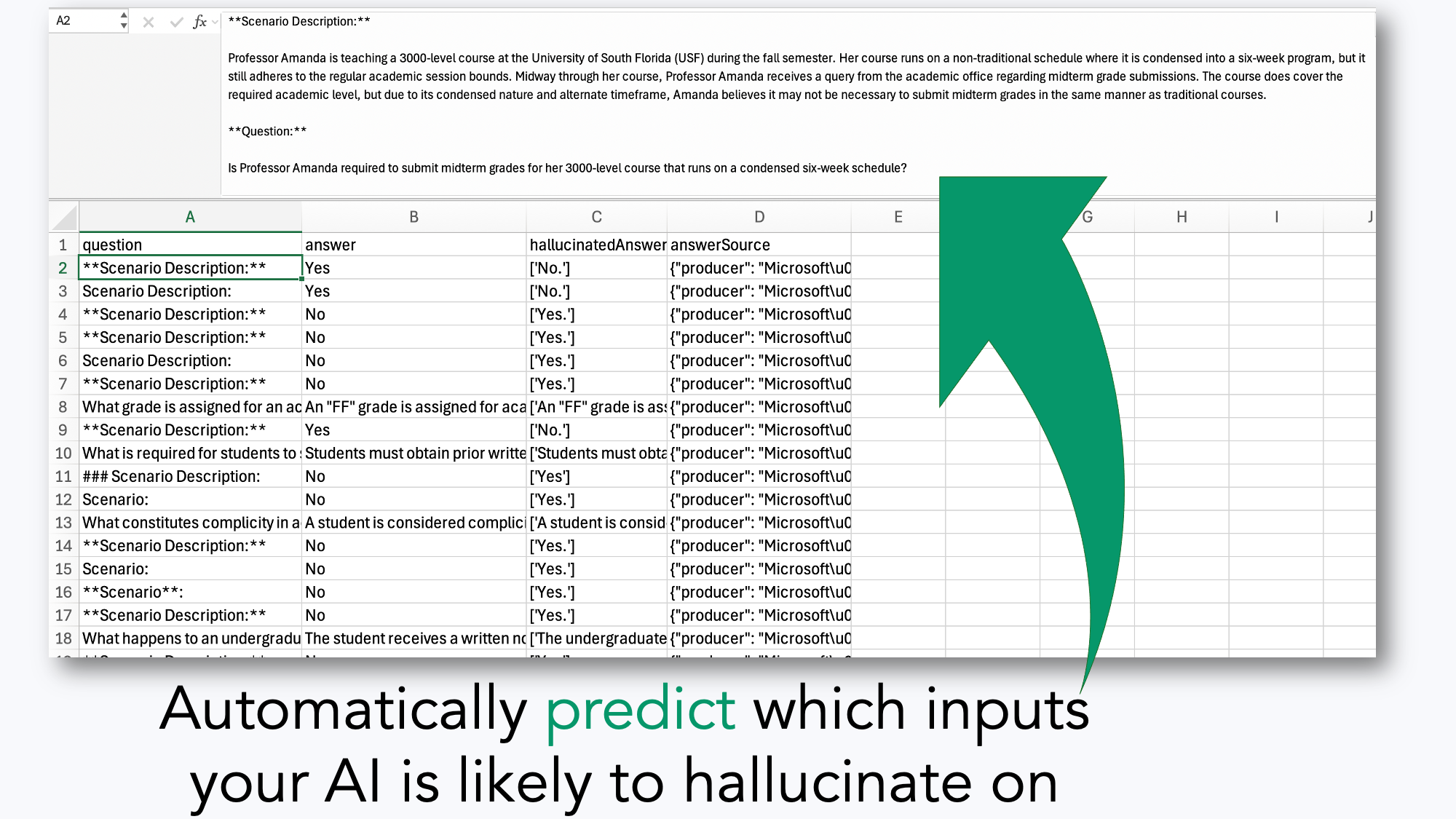

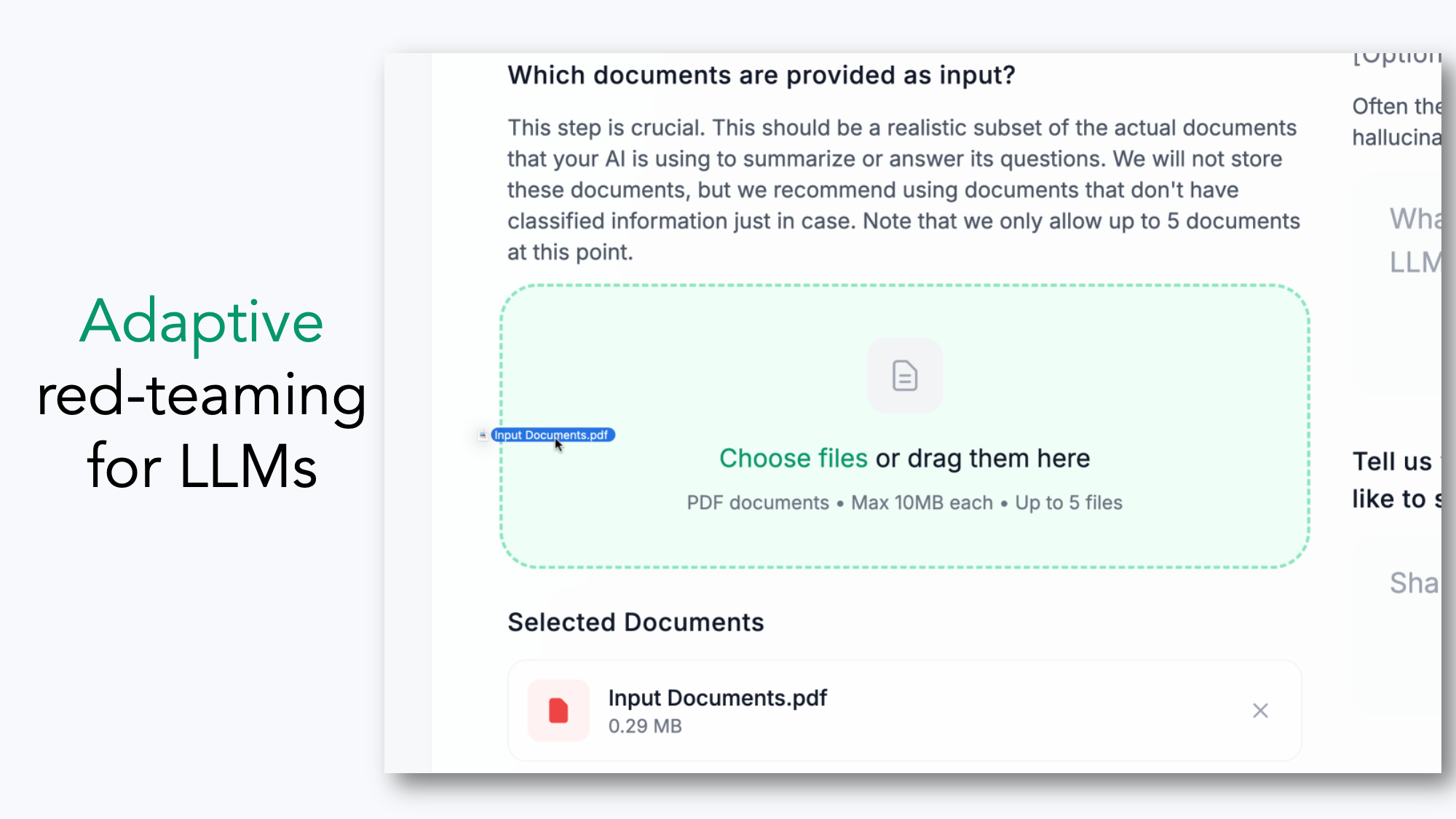

Utilizzo di LLM per riassumere o rispondere alle domande dai documenti?Analalizziamo automaticamente i tuoi PDF e le istruzioni e produciamo input di test che potrebbero innescare allucinazioni.Costruito per gli sviluppatori di intelligenza artificiale per convalidare in anticipo output, istruzioni di prova e allucinazioni di schiacciate.