Lesen

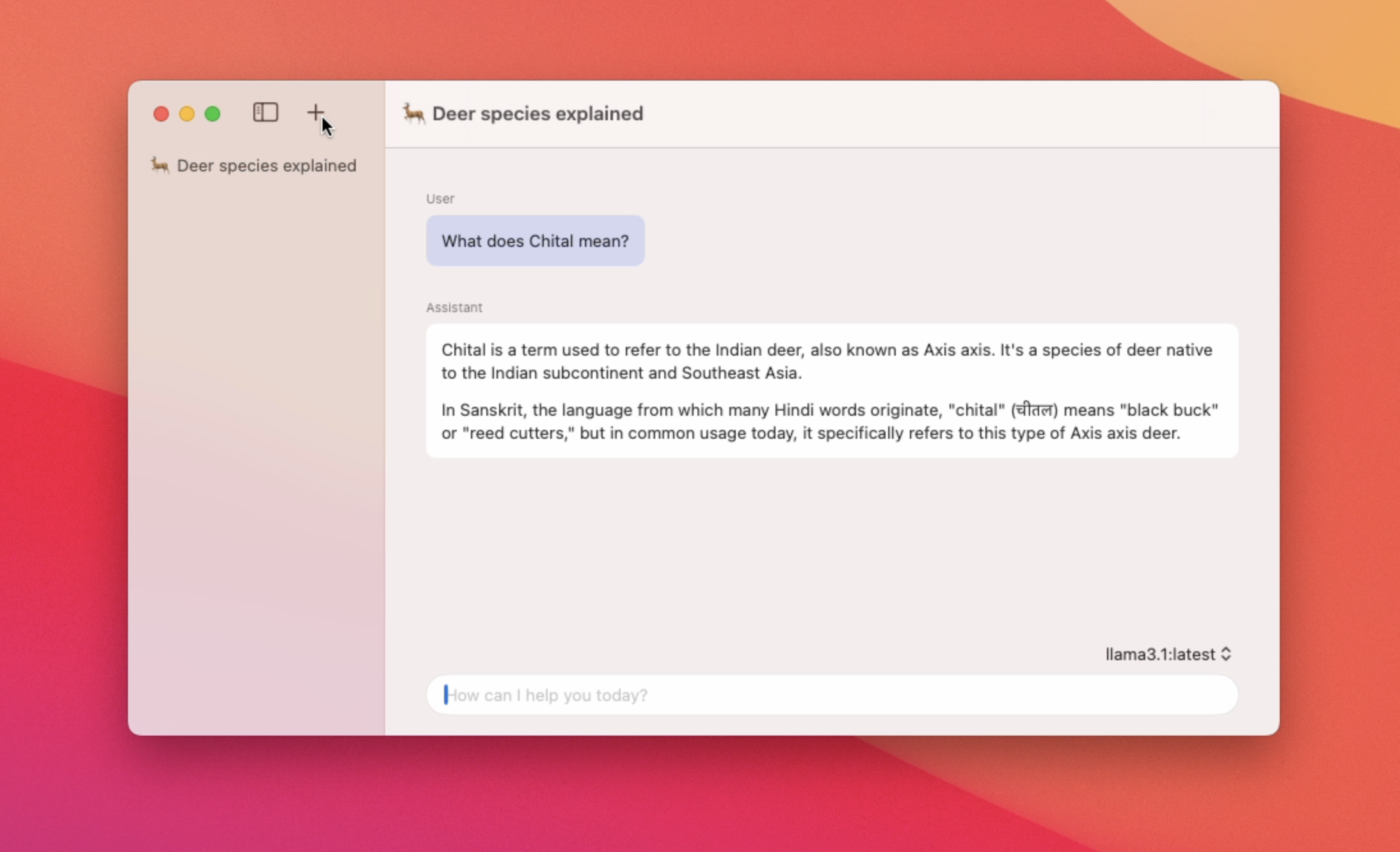

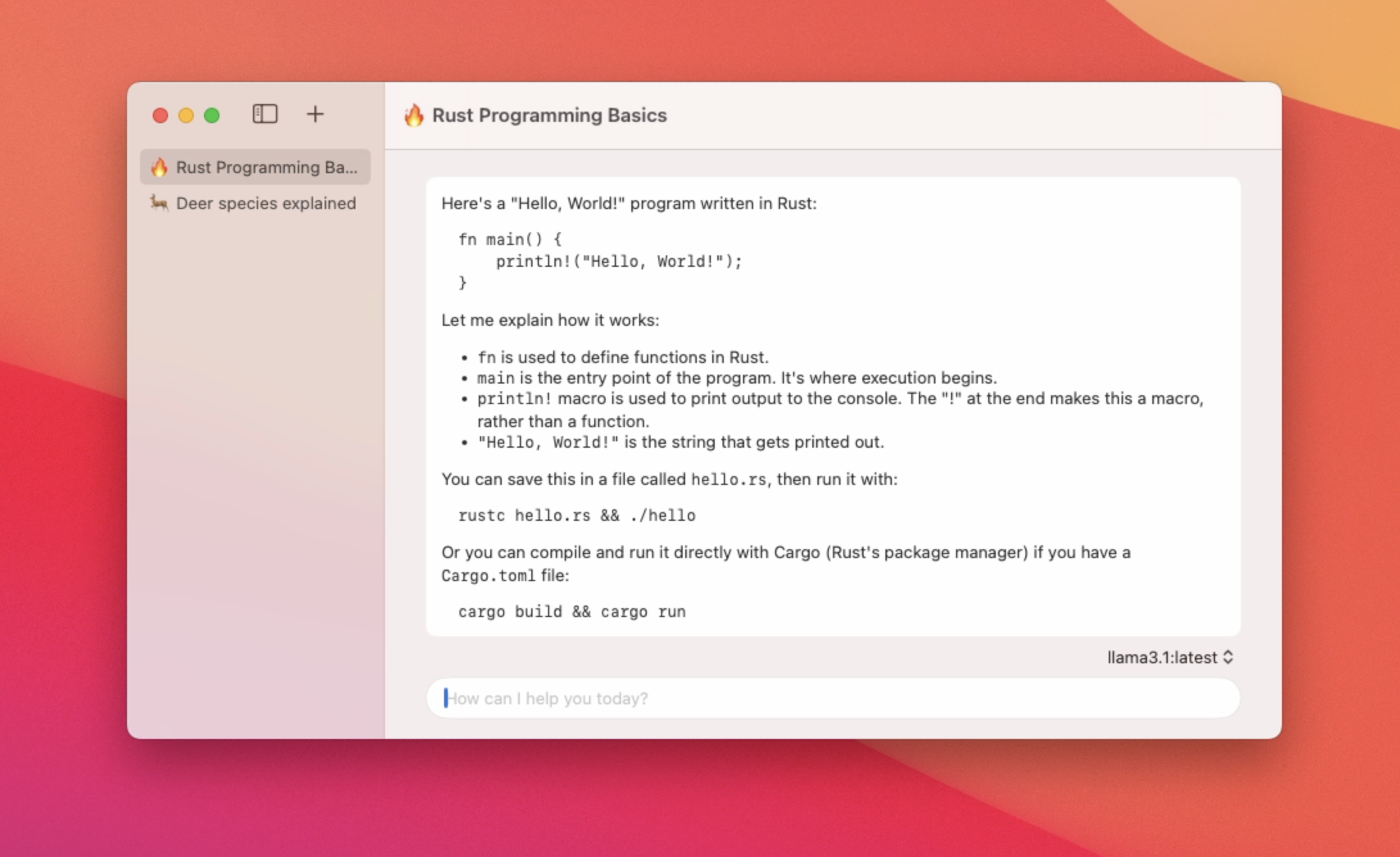

Native macOS -App zur Verwendung lokaler LLMs

Empfohlen

6 Stimmen

Beschreibung

Eine native MacOS -App zum Chatten mit OLLAMA -Models Funktionen - Niedrigspeicherverbrauch und schnelle App -Startzeiten - Unterstützung für mehrere Chat -Threads - Wechseln Sie zwischen verschiedenen Modellen - Markdown -Unterstützung - Automatische Chat -Thread -Titelübersicht