ذاكرة التخزين المؤقت ناقلات

مكتبة Python لتخزين التأكيد الفعال لاستفسار LLM

مميز

23 الأصوات

الوصف

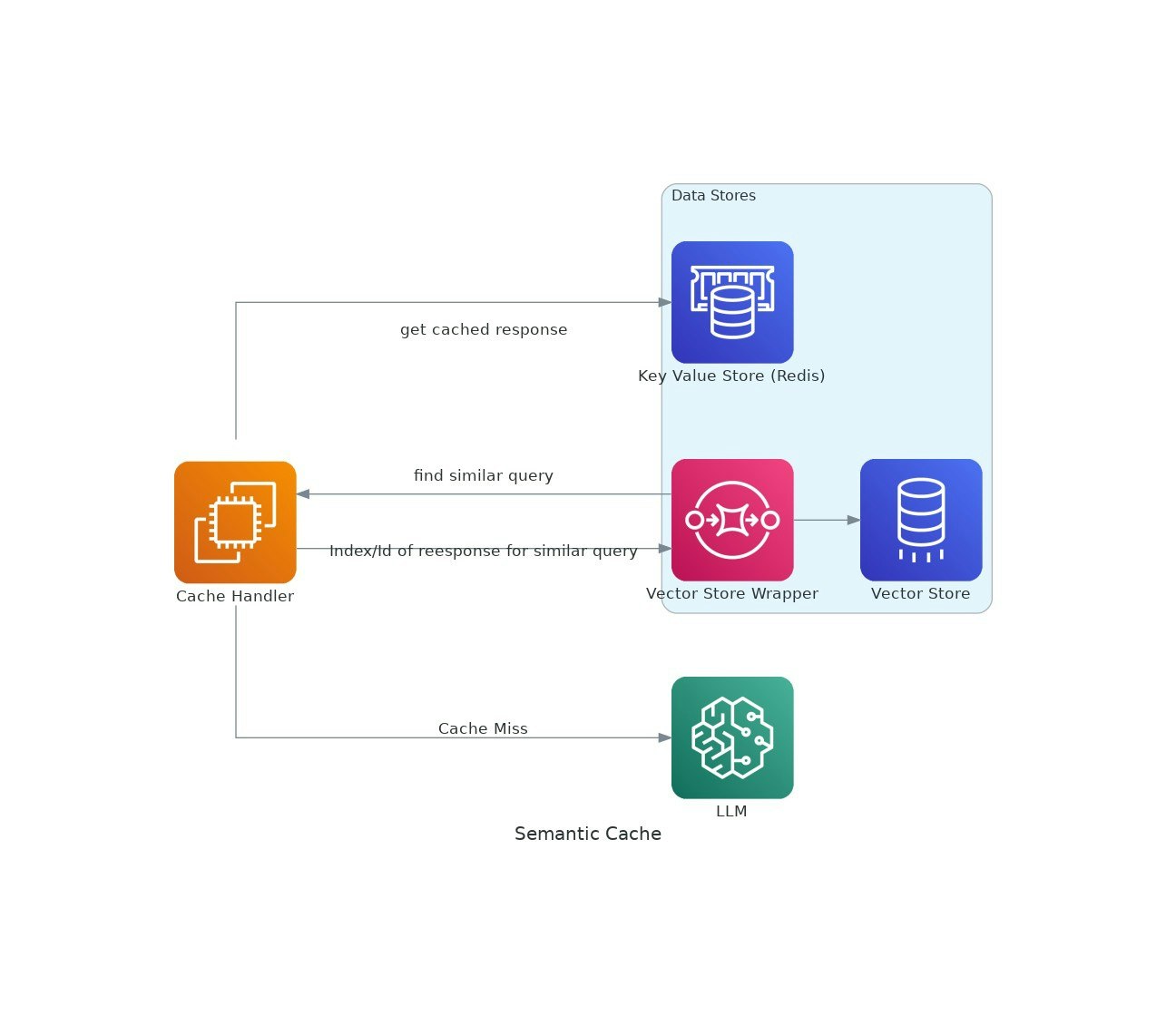

عندما تكتسب تطبيقات الذكاء الاصطناعى الجر ، يمكن أن تتصاعد تكاليف استخدام نماذج اللغة الكبيرة (LLMS).يعالج VectorCache هذه المشكلات عن طريق التخزين المؤقت لاستجابات LLM بناءً على التشابه الدلالي ، وبالتالي تقليل تكاليف الأوقات وأوقات الاستجابة.