Vektör önbelleği

Verimli LLM sorgusu önbelleğe alınması için bir Python Kütüphanesi

Öne Çıkan

23 Oylar

Açıklama

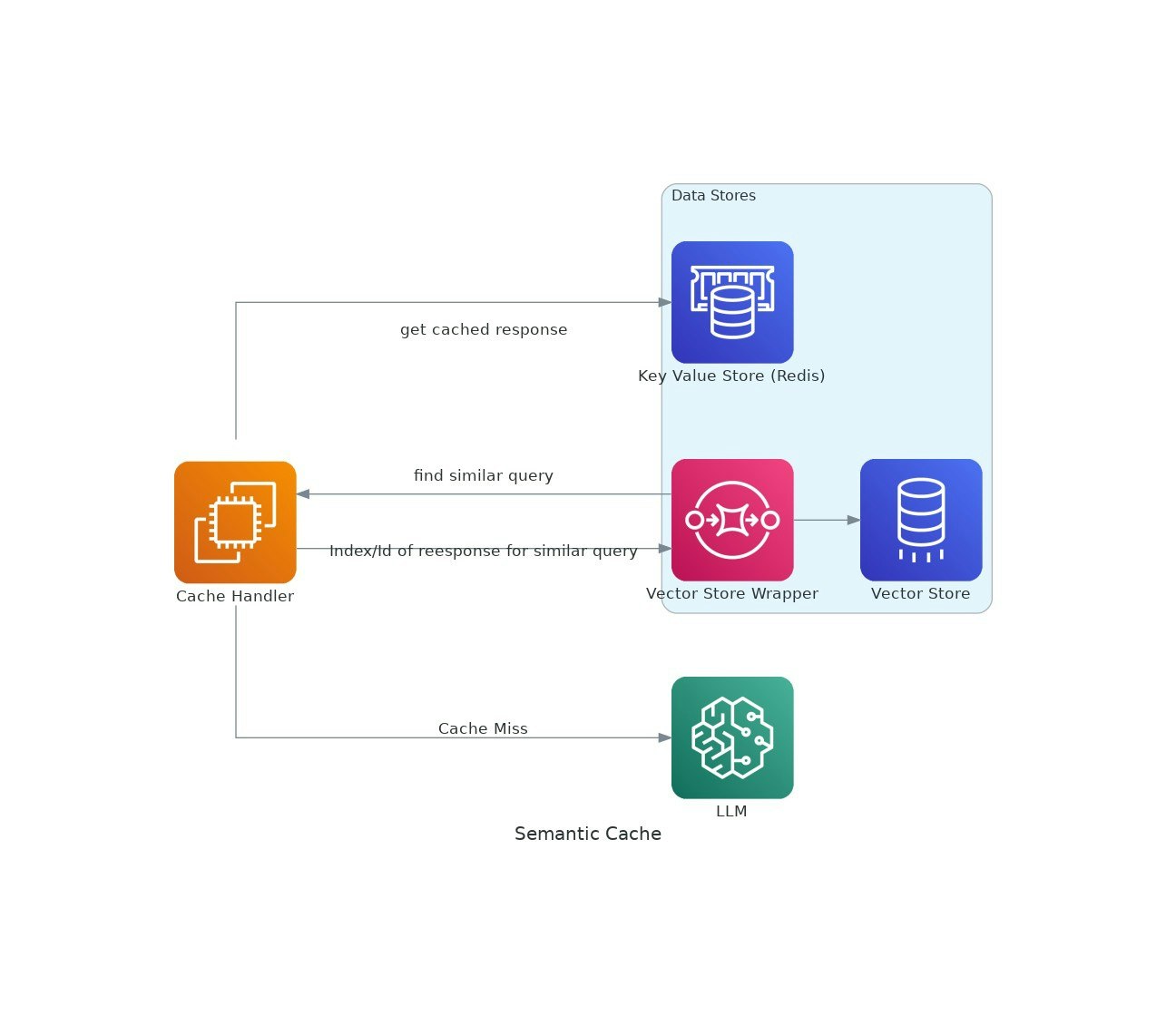

Yapay zeka uygulamaları çekiş kazandıkça, büyük dil modellerinin (LLM'ler) kullanılmasının maliyetleri ve gecikmesi artabilir.VectorCache, anlamsal benzerliğe dayalı LLM yanıtlarını önbelleğe alarak bu sorunları ele alır, böylece hem maliyetleri hem de yanıt sürelerini azaltır.