แคชเวกเตอร์

ไลบรารี Python สำหรับการแคชแบบสอบถาม LLM ที่มีประสิทธิภาพ

เด่น

23 โหวต

คำอธิบาย

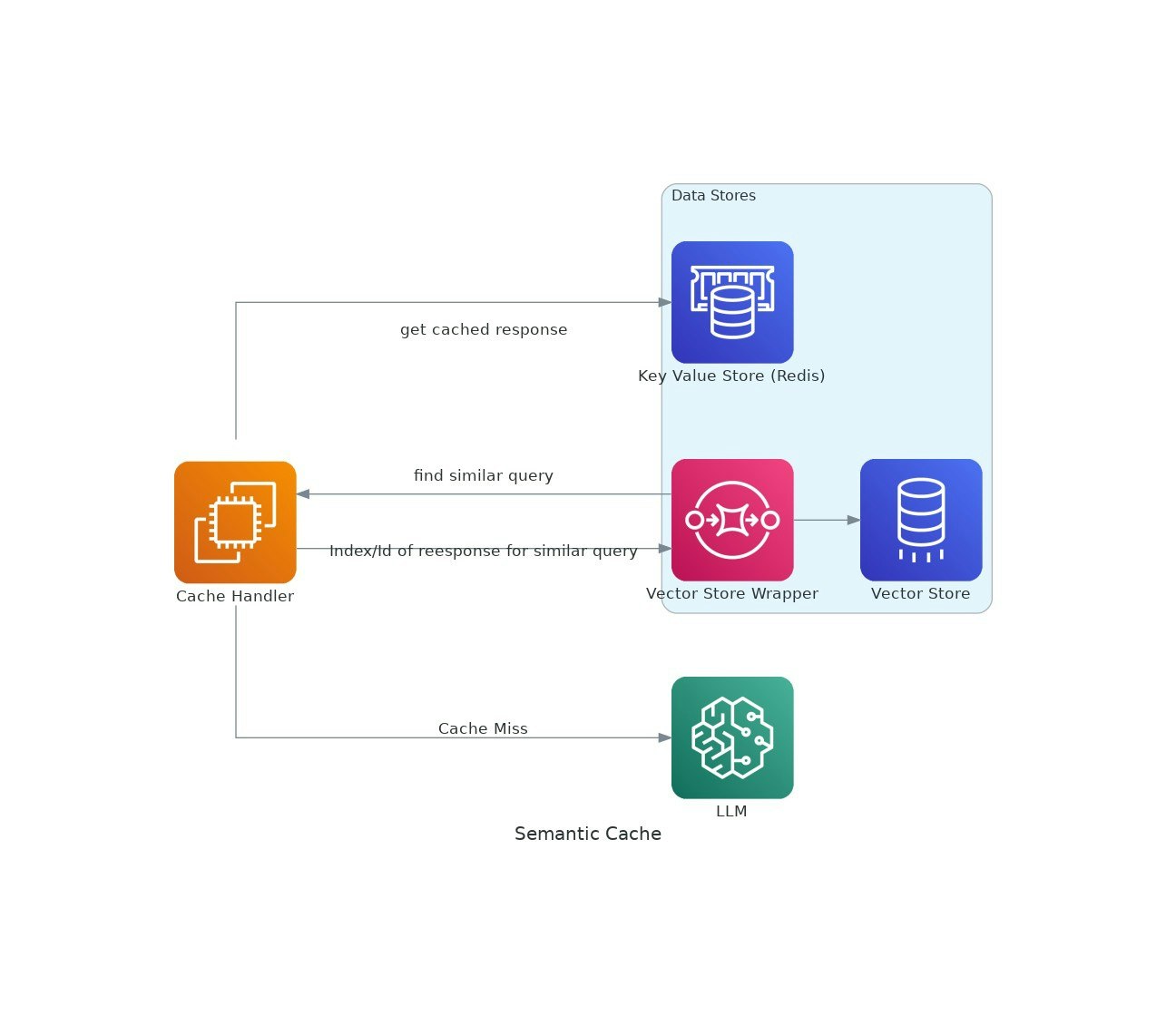

ในฐานะที่เป็นแอปพลิเคชัน AI ได้รับแรงฉุดค่าใช้จ่ายและเวลาแฝงของการใช้แบบจำลองภาษาขนาดใหญ่ (LLMS) สามารถเพิ่มขึ้นได้VectorCache จัดการกับปัญหาเหล่านี้โดยการแคชการตอบสนอง LLM ตามความคล้ายคลึงกันทางความหมายซึ่งจะช่วยลดทั้งค่าใช้จ่ายและเวลาตอบสนอง