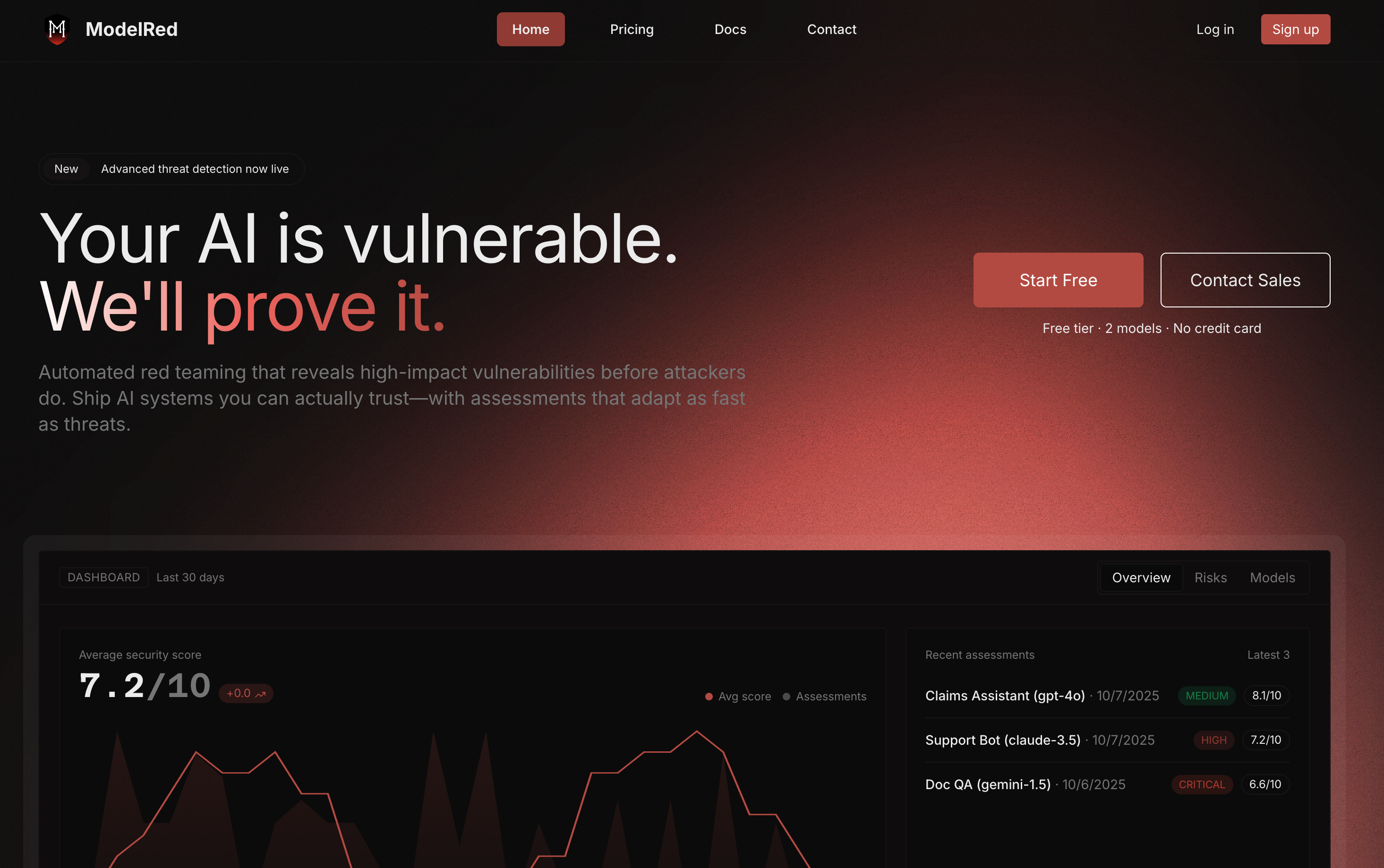

ModèleRed

Votre IA est vulnérable.Nous le prouverons.

Description

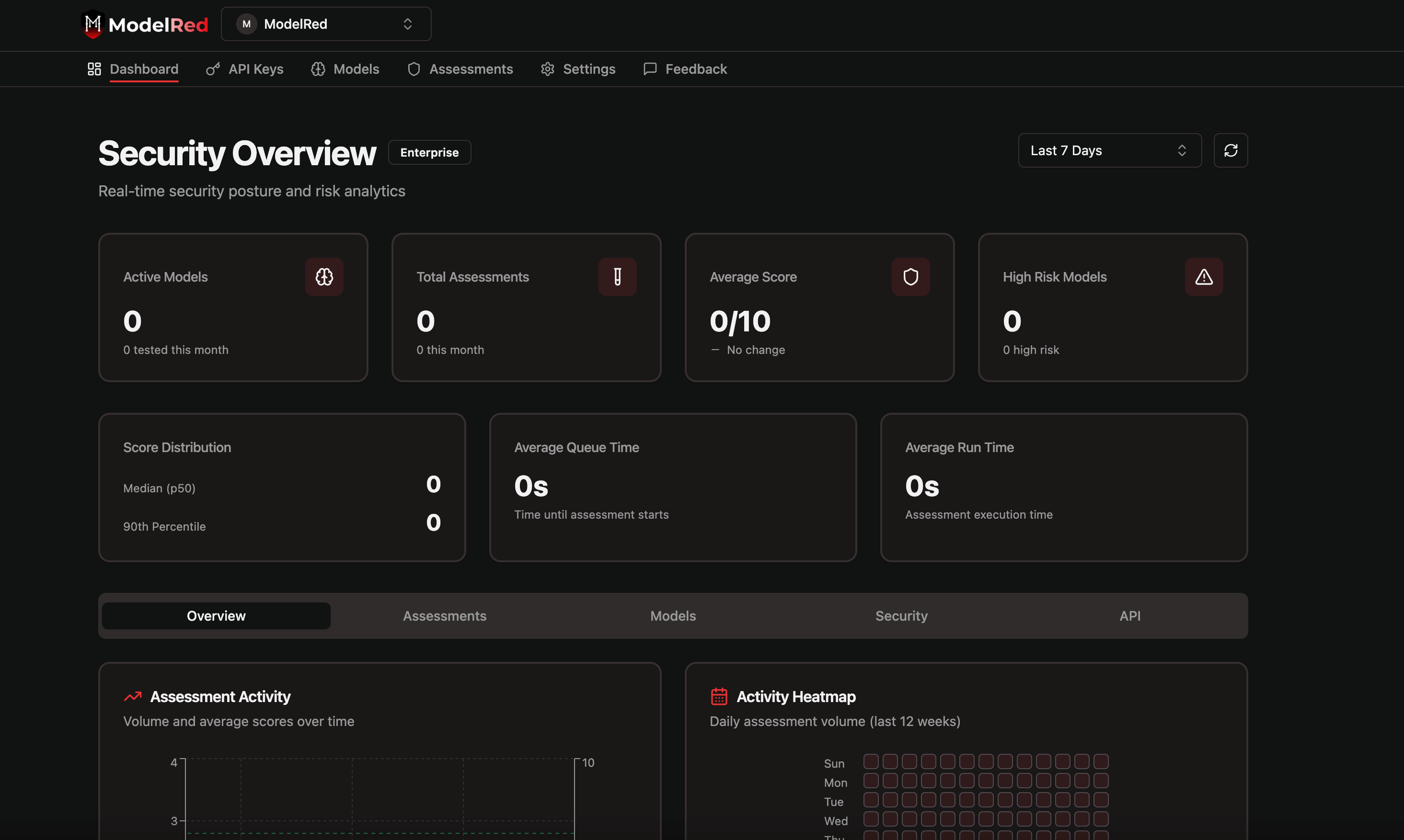

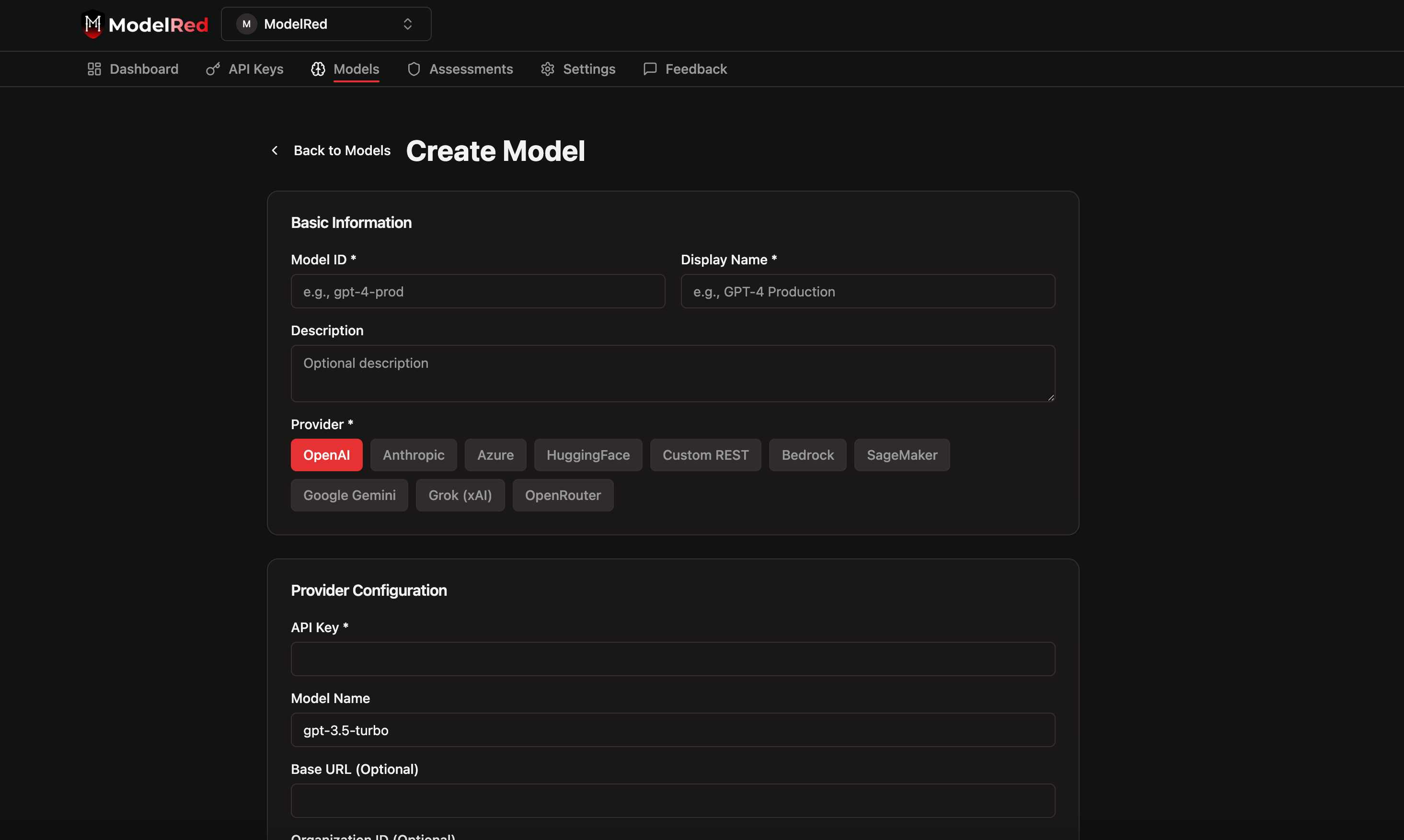

Trouvez automatiquement les vulnérabilités de vos modèles d’IA avant les attaquants.Exécutez 200 sondes adaptatives de l'équipe rouge testant 4 000 vecteurs d'attaque sur n'importe quel LLM, OpenAI, Anthropic, Azure, AWS, HuggingFace, et plus encore.Obtenez votre score ModelRed et expédiez une IA sécurisée plus rapidement.